Francuski startup Mistral AI ponownie udowodnił, że można tworzyć konkurencyjne modele językowe, które nie wymagają gigantycznych zasobów obliczeniowych. Firma właśnie zaprezentowała swój najnowszy model – Mistral Small 3, który przy 24 miliardach parametrów osiąga wydajność porównywalną z modelami trzykrotnie większymi. To przełom, który może znacząco wpłynąć na koszty wdrażania zaawansowanej sztucznej inteligencji.

Wydajność na poziomie największych modeli

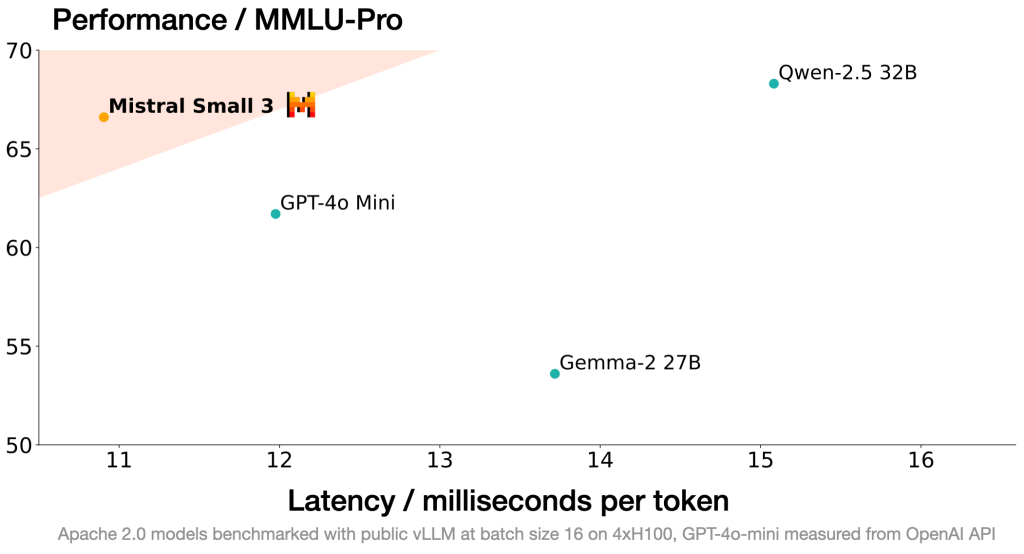

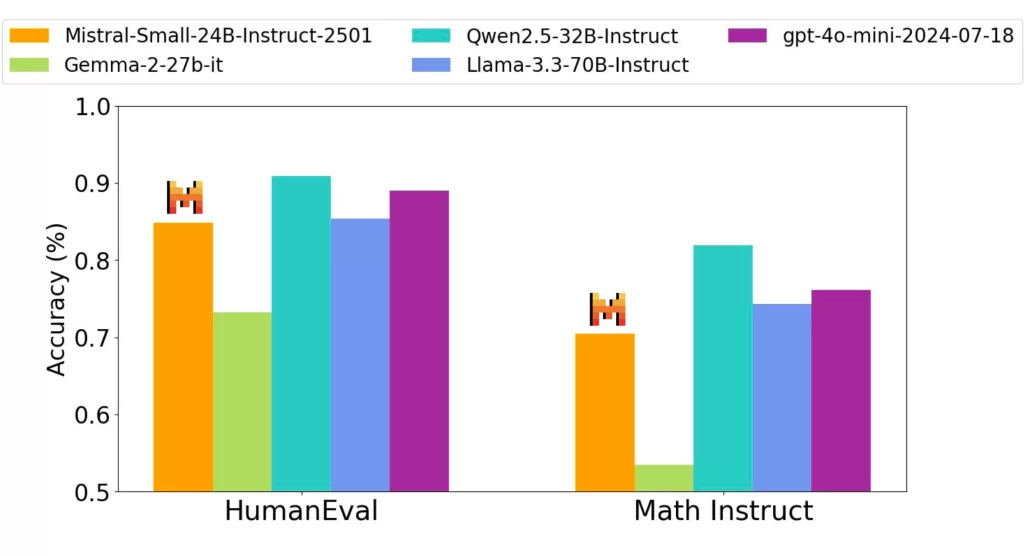

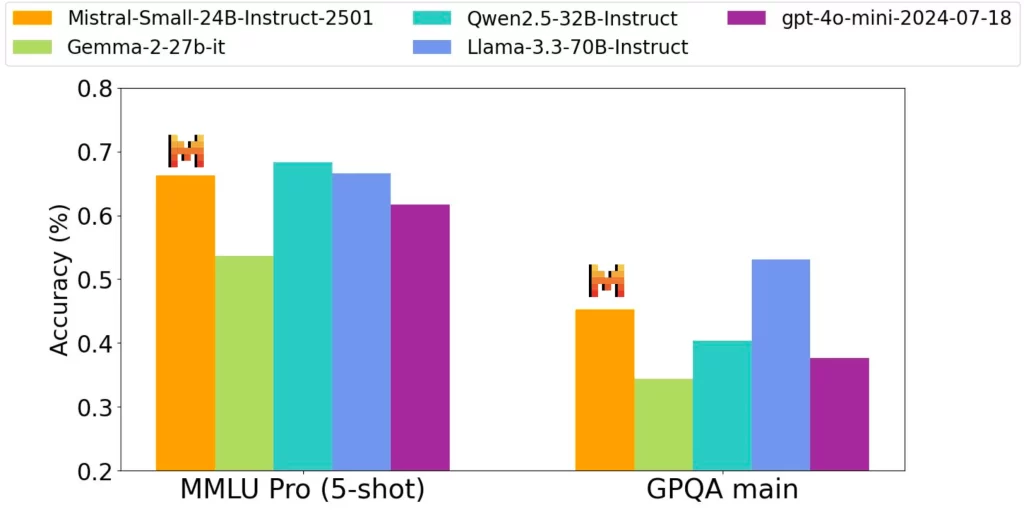

Według Mistral AI, Mistral Small 3 osiąga 81% dokładności w standardowych testach, przetwarzając przy tym 150 tokenów na sekundę. Co istotne, firma zdecydowała się na licencję Apache 2.0, co oznacza, że model może być swobodnie modyfikowany i wdrażany przez przedsiębiorstwa.

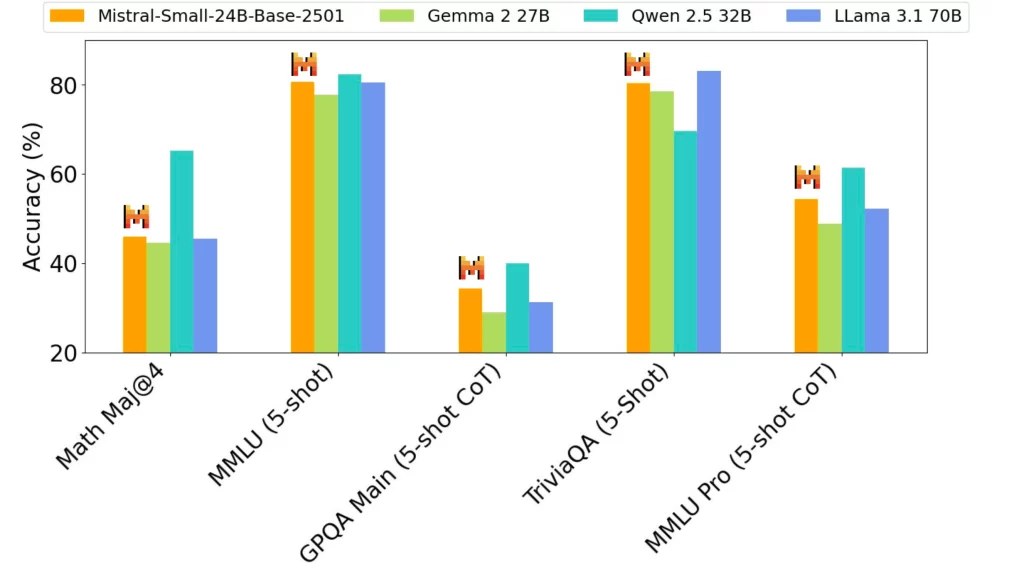

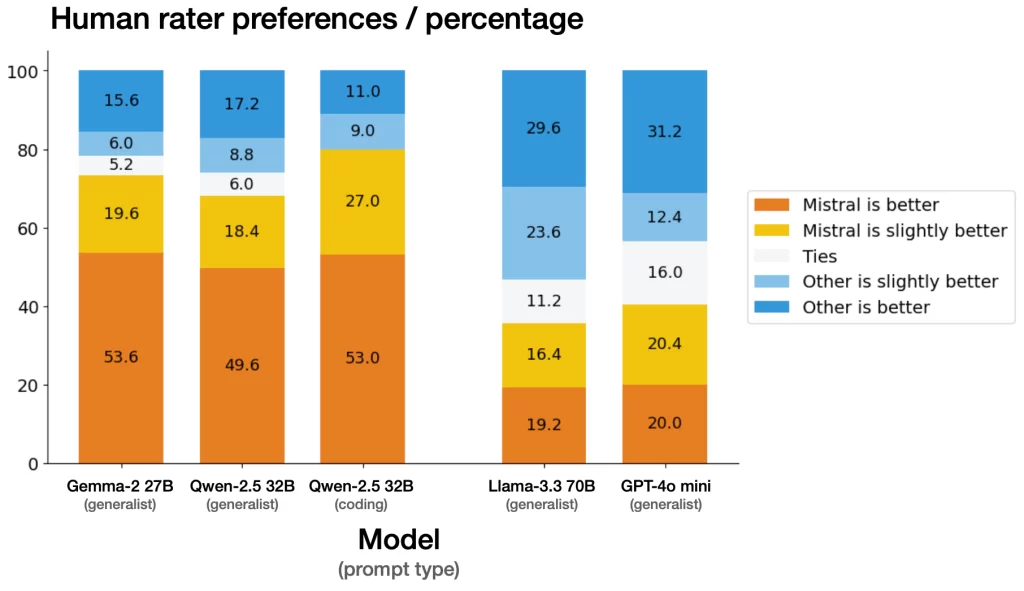

– Uważamy, że jest to najlepszy model spośród wszystkich o rozmiarze poniżej 70 miliardów parametrów – powiedział Guillaume Lample, główny naukowiec Mistral AI, w rozmowie z VentureBeat. Dodał także, że model osiąga wyniki porównywalne z Meta Llama 3.3 70B, mimo że jest od niego trzykrotnie mniejszy.

Nowe podejście do trenowania modeli

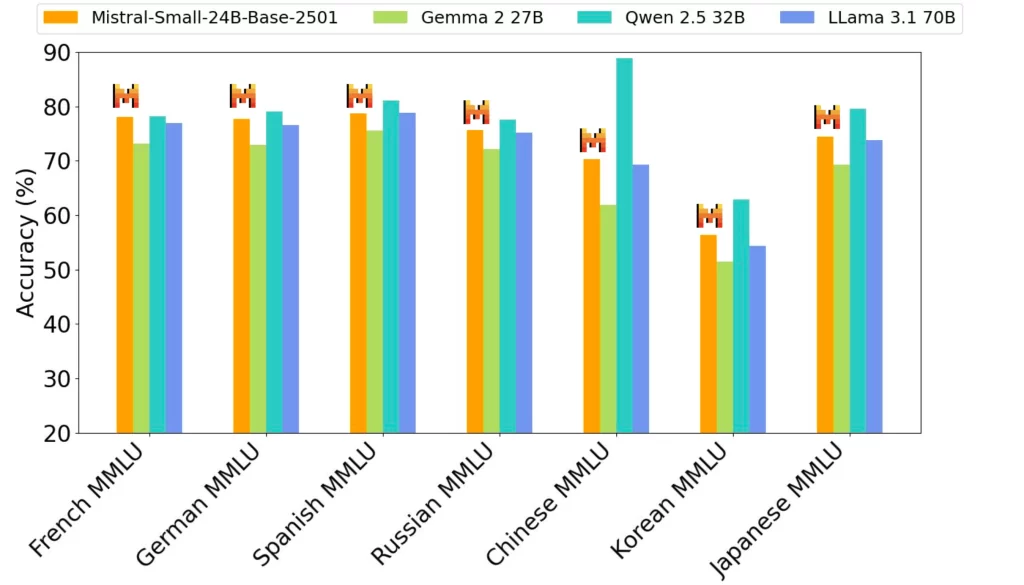

Mistral AI skupiło się na optymalizacji procesu trenowania, zamiast na zwiększaniu rozmiaru modelu.

– Zmieniliśmy techniki optymalizacji treningu – wyjaśnił Lample. – To, jak trenowaliśmy model, było inne – znaleźliśmy nowy sposób na jego optymalizację – dodał.

Model został przeszkolony na 8 bilionach tokenów, co jest znacznie niższą liczbą w porównaniu do innych modeli o podobnej wydajności (np. 15 bilionów tokenów w konkurencyjnych rozwiązaniach). W dodatku nie wykorzystywano wzmacnianego uczenia maszynowego ani syntetycznych danych treningowych, co może przełożyć się na bardziej neutralne wyniki generowane przez model.

Przewaga mniejszych modeli dla biznesu

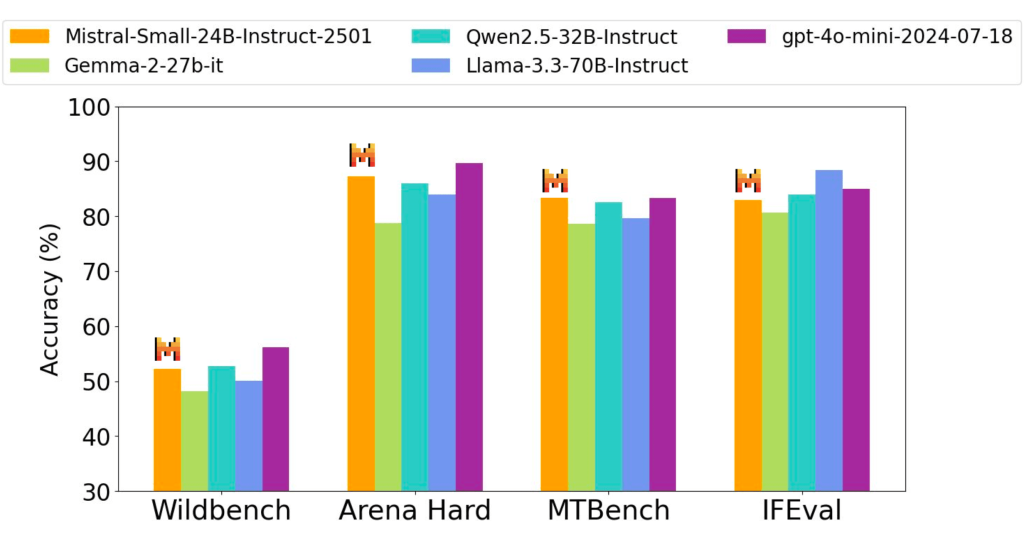

Mistral Small 3 to propozycja dla firm, które potrzebują prywatnych i niezależnych rozwiązań AI. Może być wdrażany on-premises, co szczególnie docenią branże takie jak finanse, opieka zdrowotna czy produkcja.

– Wielu naszych klientów chce rozwiązania on-premises, ponieważ zależy im na prywatności i niezawodności – zaznaczył Lample. Model może działać na pojedynczym GPU, a mimo to spełnia 80–90% typowych zastosowań biznesowych.

Czy Mistral AI stanie się europejskim liderem open-source AI?

Wraz z rosnącą wyceną (obecnie 6 miliardów dolarów) i inwestycjami od Microsoftu, Mistral AI coraz bardziej umacnia swoją pozycję w globalnym wyścigu o dominację w AI. Firma wyróżnia się na tle OpenAI czy Anthropic, które stawiają na coraz większe modele, wymagające potężnych zasobów.

Lample przewiduje, że trend tworzenia mniejszych, bardziej zoptymalizowanych modeli z otwartymi licencjami będzie się nasilał: „Sądzimy, że warunkowe modele open-source staną się standardem.”

Przyszłość AI w duchu optymalizacji

Mistral AI już zapowiedziało premierę kolejnych modeli o zwiększonych zdolnościach rozumowania, co może stanowić kolejny krok naprzód w rywalizacji z gigantami technologicznymi.

W obliczu rosnących kosztów obliczeniowych i potrzeby zwiększonej dostępności AI, strategia Mistral AI może być kluczem do demokratyzacji zaawansowanej sztucznej inteligencji, oferując firmom wydajne rozwiązania przy niższych nakładach infrastrukturalnych.

Źródło: VentureBeat | Mistral AI